Người dùng Microsoft Azure giờ đây có thể tận dụng công nghệ điện toán tăng tốc mới nhất của NVIDIA để đào tạo, triển khai và xây dựng các ứng dụng AI tổng quát. Máy ảo Microsoft Azure ND H100 v5, được cung cấp bởi GPU lõi Tensor NVIDIA H100 và NVIDIA Lượng tử-2 Mạng InfiniBand, hiện đã có sẵn cho khách hàng trên khắp Hoa Kỳ. Sản phẩm mới này xuất hiện vào thời điểm các nhà phát triển và nhà nghiên cứu đang ngày càng sử dụng các mô hình ngôn ngữ lớn (LLM) và điện toán tăng tốc để khám phá các trường hợp sử dụng mới của người tiêu dùng và doanh nghiệp.

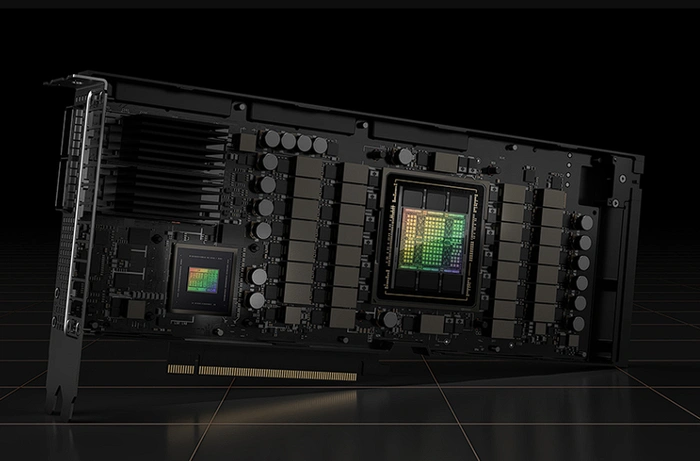

GPU NVIDIA H100, một thành phần quan trọng của sản phẩm mới này, mang lại hiệu năng ở đẳng cấp siêu máy tính thông qua một loạt cải tiến về kiến trúc. Chúng bao gồm Tensor Cores thế hệ thứ tư, một Transformer Engine mới được thiết kế để tăng tốc LLM và công nghệ NVLink mới nhất cho phép các GPU giao tiếp với nhau với tốc độ đáng kinh ngạc là 900GB/giây.

Xây dựng các ứng dụng AI tổng quát

Nâng cao hơn nữa hiệu suất của sản phẩm mới này là việc đưa vào NVIDIA Quantum-2 CX7 InfiniBand. Với băng thông nút chéo là 3.200 Gbps, công nghệ này đảm bảo hiệu suất liền mạch trên các GPU ở quy mô lớn, phù hợp với khả năng của các siêu máy tính có hiệu suất hàng đầu thế giới.

Máy ảo ND H100 v5 đặc biệt phù hợp để đào tạo và chạy suy luận cho các mô hình thị giác máy tính và LLM ngày càng phức tạp. Các mạng thần kinh này cung cấp năng lượng cho các ứng dụng AI tổng hợp đòi hỏi khắt khe và tính toán chuyên sâu nhất, bao gồm trả lời câu hỏi, tạo mã, tạo âm thanh, video và hình ảnh, nhận dạng giọng nói, v.v.

Các bài viết khác có thể bạn quan tâm về chủ đề Generative AI:

Về hiệu suất, máy ảo ND H100 v5 đã chứng tỏ tiềm năng tối ưu hóa hơn nữa các ứng dụng AI, đạt được tốc độ tăng gấp 2 lần trong các LLM như mô hình BLOOM 175B dành cho suy luận so với các phiên bản thế hệ trước.

Việc tích hợp GPU NVIDIA H100 Tensor Core trên Azure mang đến cho doanh nghiệp hiệu suất, tính linh hoạt và quy mô cần thiết để tăng cường khối lượng công việc suy luận và đào tạo AI của họ. Sự kết hợp này hợp lý hóa việc phát triển và triển khai AI sản xuất, với bộ phần mềm NVIDIA AI Enterprise được tích hợp với Azure Machine Learning cho MLOps. Sự kết hợp mạnh mẽ này mang lại hiệu suất AI lập kỷ lục trong các tiêu chuẩn MLPerf tiêu chuẩn ngành, đánh dấu một cột mốc quan trọng trong lĩnh vực phát triển ứng dụng AI.

nguồn: NVIDIA

Tuyên bố từ chối trách nhiệm: Một số bài viết của chúng tôi bao gồm các liên kết liên kết. Nếu bạn mua thứ gì đó thông qua một trong những liên kết này, APS Blog có thể kiếm được hoa hồng liên kết. Tìm hiểu về Chính sách tiết lộ của chúng tôi.